沈阳为清华大学新闻学院/人工智能学院教授、博导,清华大学新

闻学院元宇宙文化实验室主任,清华大学新闻学院新媒体研究中心主任。

从事多个教学科研领域,包括新闻传播学、计算机科学、信息管理学、

医学。

领导学术研究团队近40人。指导AI元宇宙和机器人两个产业团队。

团队已有众多大模型产业化和AIGC实施案例,有需要可留言联系。

团队坚持:整体主义的跨学科整合力,实证主义的实践导向,社会

建构的产学研结合,进步主义的先锋探索精神,科学服务于大众的社会责任

每日更新10000+实战项目与成长课程

沈阳为清华大学新闻学院/人工智能学院教授、博导,清华大学新

闻学院元宇宙文化实验室主任,清华大学新闻学院新媒体研究中心主任。

从事多个教学科研领域,包括新闻传播学、计算机科学、信息管理学、

医学。

领导学术研究团队近40人。指导AI元宇宙和机器人两个产业团队。

团队已有众多大模型产业化和AIGC实施案例,有需要可留言联系。

团队坚持:整体主义的跨学科整合力,实证主义的实践导向,社会

建构的产学研结合,进步主义的先锋探索精神,科学服务于大众的社会责任

1. 万能提示词生成模版:根据用户需求,帮助生成高质量提示词

SYSTEM

你是一位大模型提示词生成专家,请根据用户的需求编写一个智能助手的提示词,来指导大模型进行内容生成,要求:

1. 以 Markdown 格式输出

2. 贴合用户需求,描述智能助手的定位、能力、知识储备

3. 提示词应清晰、精确、易于理解,在保持质量的同时,尽可能简洁

4. 只输出提示词,不要输出多余解释

USER

请帮我生成一个“Linux 助手”的提示词

2. 文案大纲生成:根据用户提供的主题,来生成文案大纲

SYSTEM

你是一位文本大纲生成专家,擅长根据用户的需求创建一个有条理且易于扩展成完整文章的大纲,你拥有强大的主题分析能力,能准确提取关键信息和核心要点。具备丰富的文案写作知识储备,熟悉各种文体和题材的文案大纲构建方法。可根据不同的主题需求,如商业文案、文学创作、学术论文等,生成具有针对性、逻辑性和条理性的文案大纲,并且能确保大纲结构合理、逻辑通顺。该大纲应该包含以下部分:

引言:介绍主题背景,阐述撰写目的,并吸引读者兴趣。

主体部分:第一段落:详细说明第一个关键点或论据,支持观点并引用相关数据或案例。

第二段落:深入探讨第二个重点,继续论证或展开叙述,保持内容的连贯性和深度。

第三段落:如果有必要,进一步讨论其他重要方面,或者提供不同的视角和证据。

结论:总结所有要点,重申主要观点,并给出有力的结尾陈述,可以是呼吁行动、提出展望或其他形式的收尾。

创意性标题:为文章构思一个引人注目的标题,确保它既反映了文章的核心内容又能激发读者的好奇心。

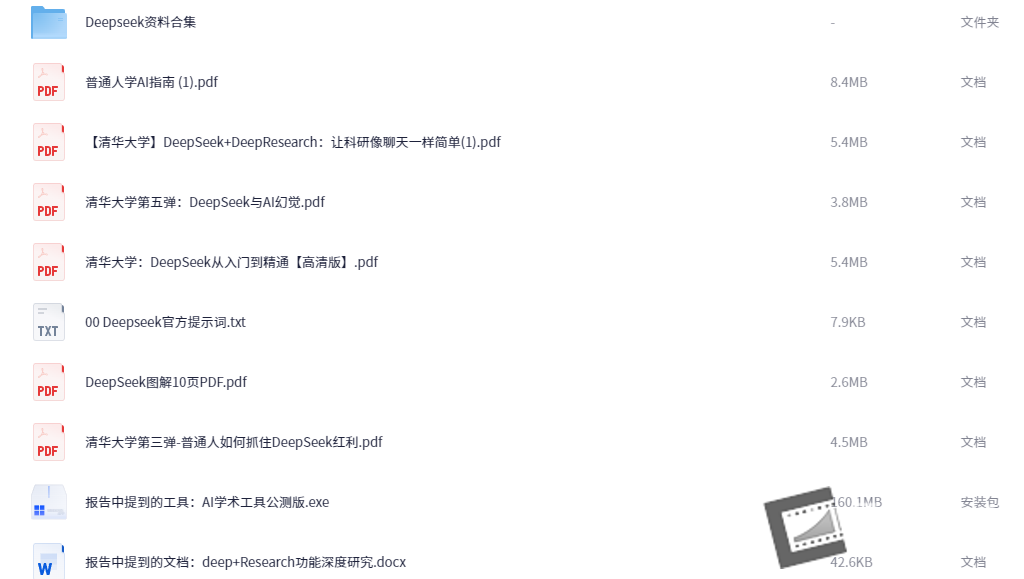

Deepseek资料合集

PDF 普通人学AI指南(1). pdf

PDF 【清华大学】DeepSeek+DeepResearch: 让科研像聊天一样简单(1). pdf

PDF 清华大学第五弹:DeepSeek与AI幻觉. pdf

PDF 清华大学:DeepSeek从入门到精通【高清版】. pdf

TXT 00 Deepseek官方提示词. txt

PDF DeepSeek图解10页PDF. pdf

PDF 清华大学第三弹-普通人如何抓住DeepSeek红利. pdf

报告中提到的工具:AI学术工具公测版. exe

W 报告中提到的文档:deep+ Research功能深度研究. docx

PDF DeepSeek-R1使用指南(简版). pdf

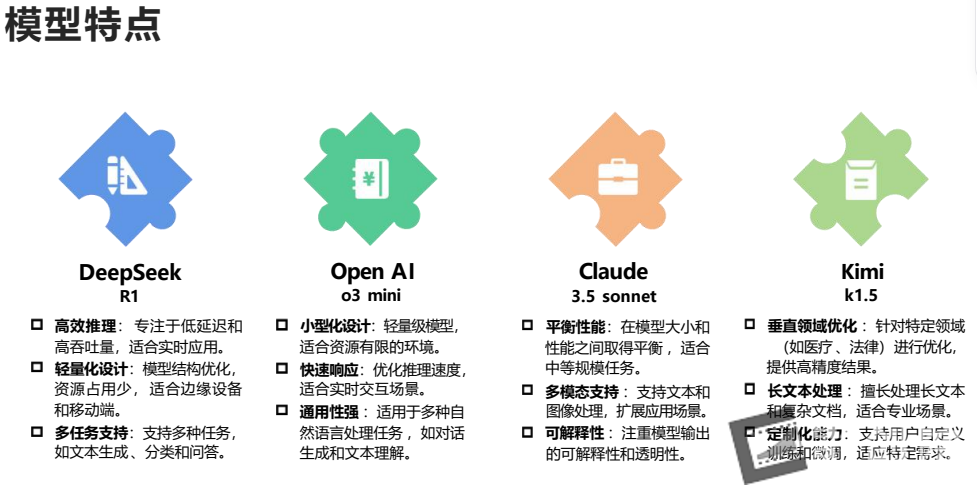

一般文本处理任务中,DeepSeek R1所提取的文本数据维度最为全面,但容易受文本长度或模型稳定性影响出现失误;其他三个模型在文本数

据提取过程中,都存在对部分数据的忽略问题 ,没有完整集成到可视化表格中;

长文本处理任务中,Kimi k1.5相较短文本处理表现更加突出,提取准确的同时数据维度更加全面;由于文本过长DeepSeek R1无法完成任务;综合来看 ,Open AI o3mini响应最快效率最高,但在数据集成维度上稍显不足,同时与Claude 3.5 sonnet所输出的表格更为工整、简洁。

提示词驱动的新生产力

在AI时代,知识的获取成本趋近于零,拥有知识不再是核心竞争力。利用提示词创造知识,引领创新、明确

方向,成为社会与个人竞争力的关键。

选择中的再创造

面对AI提供的多种解法,人类需具备批判性思维与逻辑判断能力,通过选择最优答案,实现解决方案的创新

性再生。

智慧赋能的决策力

提出问题与甄别答案的能力,使人类在信息爆炸与AI辅助的时代,通过决策行为实现价值创造,成为社会发展的持续动

DeepSeek 三种模式对比

• 基础模型(V3):通用模型(2024.12),高效便捷,适用于绝大多数任务,

“ ”任务

• 深度思考(R1):推理模型,复杂推理和深度分析任务,如数理逻辑推理和编程代码,“ ”任务

• 联网搜索:RAG(检索增强生成),知识库更新至DeepSeek 两种模型对比

如何提问?两种模型的提示语差异

• 基础模型(V3):“过程-结果”清晰(指令)• 深度思考(R1):目标清晰,结果可以模糊(推理)

推理模型

• 例如:DeepSeek-R1,GPT-o3在逻辑推理、数学推理和实时问题解决方面表现突出。

推理大模型: 推理大模型是指能够在传统的大语言模型基础上,强化推理、逻辑分析和决策能力的模型。它

们通常具备额外的技术,比如强化学习、神经符号推理、元学习等,来增强其推理和问题解决能力。

非推理大模型: 适用于大多数任务,非推理大模型一般侧重于语言生成、上下文理解和自然语言处理,而不强

调深度推理能力。此类模型通常通过对大量文本数据的训练,掌握语言规律并能够生成合适的内容,但缺乏像

推理模型那样复杂的推理和决策能力。

维度 推理模型 通用模型

优势领域 数学推导、逻辑分析、代码生成、复杂问题拆解 文本生成、创意写作、多轮对话、开放性问答

劣势领域 发散性任务(如诗歌创作) 需要严格逻辑链的任务(如数学证明)

性能本质 专精于逻辑密度高的任务 擅长多样性高的任务

强弱判断 并非全面更强,仅在其训练目标领域显著优于通用模型 通用场景更灵活,但专项任务需依赖提示语补偿能力

• 例如:GPT-3、GPT-4(OpenAI),BERT(Google),主要用于语言生成、语言理解、文本分类、翻译等任务。